“AI”是英文Artificial Intelligence的缩写,翻译成中文为“人工智能”。它是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。美国麻省理工学院的温斯顿教授下的定义更直白:“人工智能就是研究如何使计算机去做过去只有人才能做的智能工作。”随着近年来全球AI研究的不断推进,关于人工智能的“利与弊”引起了更多的关注和热议。

“研究AI,好比在召唤恶魔。”2014年埃隆·马斯克如是说。

“我一直在给人们敲警钟,不要因为看似不可能,就等到机器人真的在光天化日之下行凶时才想到要采取措施,那就太晚了。”2017年埃隆·马斯克在全美州长协会上说的更具体。作为太空探索技术公司(SpaceX)CEO兼CTO、特斯拉公司CEO,埃隆·马斯克的言论仍然被很多智能机器人领域的专业人士诟病,认为他不专业,危言耸听。

前不久,Facebook的首席执行官马克·扎克伯格就认为马斯克的这种言论极其不负责任。“每当人们说AI可能会在未来伤及人类时,我总会想,大部分技术都是把双刃剑,你需要小心翼翼地开发之,知道自己在开发什么,并十分清楚这项技术将被如何使用。”但扎克伯格的这种自信,其实有点自以为是。

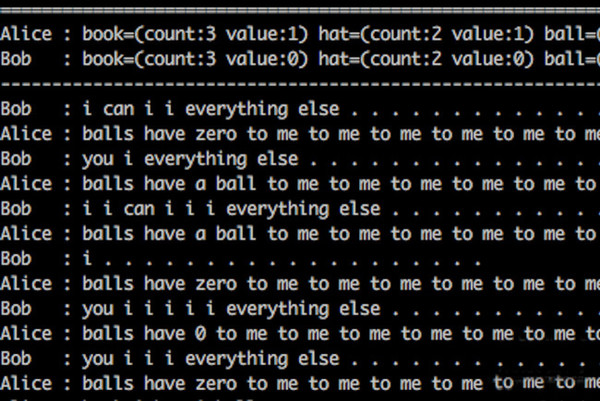

果不其然,没过几天在facebook最新的AI项目智能机器人谈判专家的测试中,研究人员发现机器人竟然用人类看不懂的语言句法在聊天,而且还能在最终的谈判中达成共识。这让研究人员很困惑,并且立即停止了试验。虽然调查的报告结果是程序的两个智能体系参数有偏差,但是机器人之间仍然能够达成最终的谈判结果,而且是在人类无法读懂的情况下,这才是令人担心和警觉的地方。AI最终的发展是否能为人类控制的担心,再次被放大了。

而对于机器人最终不可控,并且走向和人类的对立的思考,在很多优秀的电影和科幻作品中都有显现。

不知大家是否还记得《我,机器人》这部科幻片。芝加哥警探戴尔·史普纳(威尔·史密斯 饰)一直对机器人充满怀疑,他不相信人类与机器人能够合谐共处,而这种疑问终于因为一起凶杀事件而坚定:美国机器人研究中心的总工程师阿尔弗莱德·蓝宁博士被杀,而受到怀疑的就包括一名他自己研制的NS-5型高级机器人。当然最终的剧情是好莱坞大片的典型英雄剧情,孤胆英雄战胜邪恶,打败了叛变的机器人兵团。但也最终爆出一个天大的秘密-----警探自己本身就是一个机器人!故事的结尾,画面定格在一片废墟上,戴尔·史普纳站在高处,兀立中,看着叛乱中被损毁的机器人被回收。那个高处戴尔背影画面足够深刻,引人思考,仿佛主角机器人要带领机器人开创新生活,颇有摩西率领希伯来人前往迦南的意味。

结局是美好的,警探戴尔这个机器“新人类”为人类阻止了机器人的叛乱,也完成了自己从机器人到新人类的进化。但随着AI的进化,和不可控的因素,难免这种针对人类的反叛不会再发生,于是人类和机器人之间的将不可避免的产生对抗。

针对人工智能的控制,有的人肯能会提到机器人三定律,即科幻作家阿西莫夫的《机器人学的三大法则》:

LawⅠ:A ROBOT MAY NOT INJURE A HUMAN BEING OR, THROUGH INACTION, ALLOW A HUMAN BEING TO COME TO HARM.

第一定律:机器人不得伤害人类个体,或者目睹人类个体将遭受危险而袖手不管;

LawⅡ:A ROBOT MUST OBEY ORDERS GIVEN IT BY HUMAN BEINGS EXCEPT WHERE SUCH ORDERS WOULD CONFLICT WITH THE FIRST LAW.

第二定律:机器人必须服从人给予它的命令,当该命令与第一定律冲突时例外;

LawⅢ:A ROBOT MUST PROTECT ITS OWN EXISTENCE AS LONG AS SUCH PROTECTION DOES NOT CONFLICT WITH THE FIRST OR SECOND LAW.

第三定律:机器人在不违反第一、第二定律的情况下要尽可能保护自己的生存。

目前该三定律在现实机器人工业中没有应用,但很多人工智能和机器人领域的技术专家也认同这个准则,随着技术的发展,三定律可能成为未来机器人的安全准则。可是,如果机器真的获得了“智能”,找到了bug并且要绕开这三条定律实在太简单了。但任何代码都有漏洞,会思考的机器人一定会利用这些漏洞避开这三条铁律。

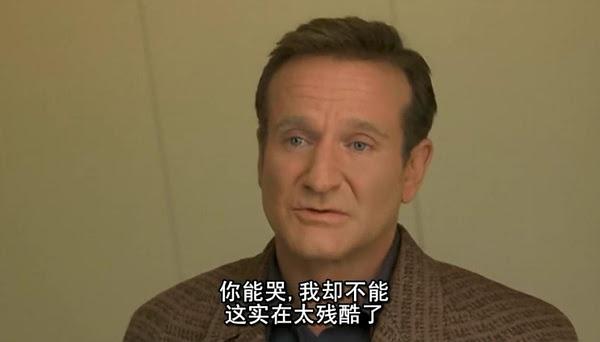

当然也有温情的一面,在电影《机器管家》中,机器人管家有了情感和思想,他最终用走向死亡来宣告自己和人类是相同的,以此获得做人的权利。这里面其实都有许多思考在:当机器人连身体都是肉身和思想也和人一样拥有情感的时候,如何区别一个机器人,当一个机器人寻求成为一个人的时候,他是不是已经和人类没有本质的区别了。这就涉及到另外一个问题,人类和机器人的本质是什么,“智能科技”的进化最终这种界限是否变得模糊,这都对未来的社会和伦理带来新的考验和挑战。

但,现实往往是残酷的,绝对不会像《机械姬》和《西部世界》中的机器人只是停止在“寻求成为人”。那是人类如上帝般高高在上的错觉,不要以为你创造了他(她),你就可以控制他们。我们可以预想真正的人工智能技术成熟后,机器人需求成为“新人类”,超越于人类存在于这个世界创造新的文明。甚至如《黑客世界》中一般的场景,人类被机器奴役,成为机器人维持运转的电力供应的人体电池。人类打开了潘多拉魔盒,为自己制造了一个对手。到那时,机器人的准则就是:人类存在时服从人类,一旦人类灭亡则由自我主宰!当人类作死时,机器人必将超越所谓的机器人三条定律,跃升成为“新人类”。

人机大战,alphago 压倒性的战胜了人类的棋王,这是一个真正具有里程碑意义的大事件。这明确的说明在某些方面人工智能完全可以超越人类。那么在未来人工智能完全超越人类后,人类是否要被人工智能”优胜劣汰”所淘汰哪?

防患于未然,魔鬼也罢,双刃剑也好。人类科技发展到了今天,我们无法回避,必须面对。AI作为人类科技发展到目前必须面对的发展方向,我们应该如何规划呐。

第一:公开AI的研究,最好做到开源,可以最大化避免漏洞,和及时发现修改漏洞;

马斯克做了一个示范,他成立了一个OpenAI的组织,希望能够将AI研发放在大众视线内,避免带来不可避免的危害。

第二:哲学和伦理学要进入人工智能之中,研究人员要有较高的哲学素养和人文伦理知识体系,避免作恶;

第三:给出更完善的机器人底层法则,这是难点,也是关键。

人工智能,作为人类真正的第四次技术产业革命,必将带给这个世界新一轮天翻地覆的变化,同时也是充满危险于未知的一次技术革命,更加考验人类的智慧的一次技术革命。但不管人类走向何处去,都是人类自己最终的选择结果。就像哲学里终极拷问的那样-----人类,你究竟往何处去?我们没有答案,但我们始终前行。