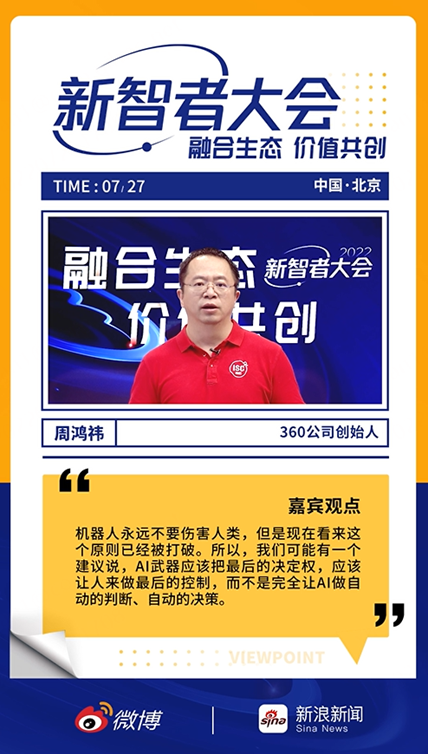

“原来机器人永远不要伤害人类的原则,现在看来已经被打破。所以,我们建议应该把AI最后的决定权交给人类,让人来做最后的控制,而不是完全让AI做自动的判断、自动的决策。”7月27日,由中国互联网协会指导、微博和新浪新闻主办的人工智能领域峰会新智者大会在京顺利召开。三六零集团创始人周鸿祎出席大会并发表主题演讲。

他指出,面对人工智能带来各种复杂安全挑战,网络安全行业应当被重新定义,将计算机安全、网络安全升维到数字安全。其中,《国家安全战略(2021年-2025年)》明确提出加快提升网络安全、数据安全、人工智能安全等领域的治理能力,这也是国家战略层面首次提出人工智能安全的概念,说明人工智能安全是数字安全的一部分。

演讲中,周鸿祎指出AI已应用在战争中,不伤人原则已被打破。今年俄乌冲突中,乌克兰军队就使用了美国的弹簧刀无人机,该无人机具备监视、侦察和打击功能,在AI的加持下,单兵就能熟练掌握。“从人下指令,到AI自动识别、自动判断、自主发起攻击,我觉得就是一层薄薄的窗户纸。所以把AI武器最后的决定权交给人类,让人来做最后的控制至关重要。人工智能最后的底线必须是人。”周鸿祎说道。

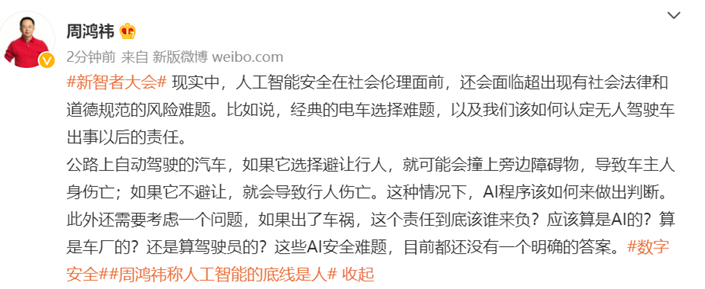

除应用于战场上外,人工智能安全也面临着七重挑战,包括:硬件、软件、通信协议、算法、数据、应用和社会伦理。周鸿祎指出经典的“电车难题”就是很好的例证。面对电车选择难题,AI程序该如何来做出判断。与此同时,如果出了车祸,这个责任到底该谁来负?应该算AI的?算车厂的?还是算驾驶员的?这些AI安全问题,目前都还没有明确答案。

然而,风险与机遇并存。对于人工智能的风险与积极作用,周鸿祎认为需辩证对待。在此方面,360一直高度重视人工智能安全,率先布局构建起人工智能安全能力体系。360不仅对自身积累的全球最大的安全大数据进行AI分析,形成了360云端安全大脑的原型,为行业或企业提供强大的数据和情报支撑;同时积极承担“安全大脑国家新一代人工智能开放创新平台”的建设;此外还牵头研发的“人工智能安全测评与风险监测预警平台”入选工信部“人工智能产业创新任务揭榜单位”名单,有效夯实了人工智能安全的底座。

值得关注的是,周鸿祎还直言仅靠一家企业不能解决所有威胁,需要注重生态合作,并表示作为中国数字安全的领军企业,360愿意开放自身安全大数据,将产学研力量联合起来,共建AI安全生态,集中推动数字安全的创新。